|

ÜBER MICH LEISTUNGEN LEBENSLAUF PROJEKTE SHORTS BLOG |

|

Lokale KI mit Internetzugang für Recherchen

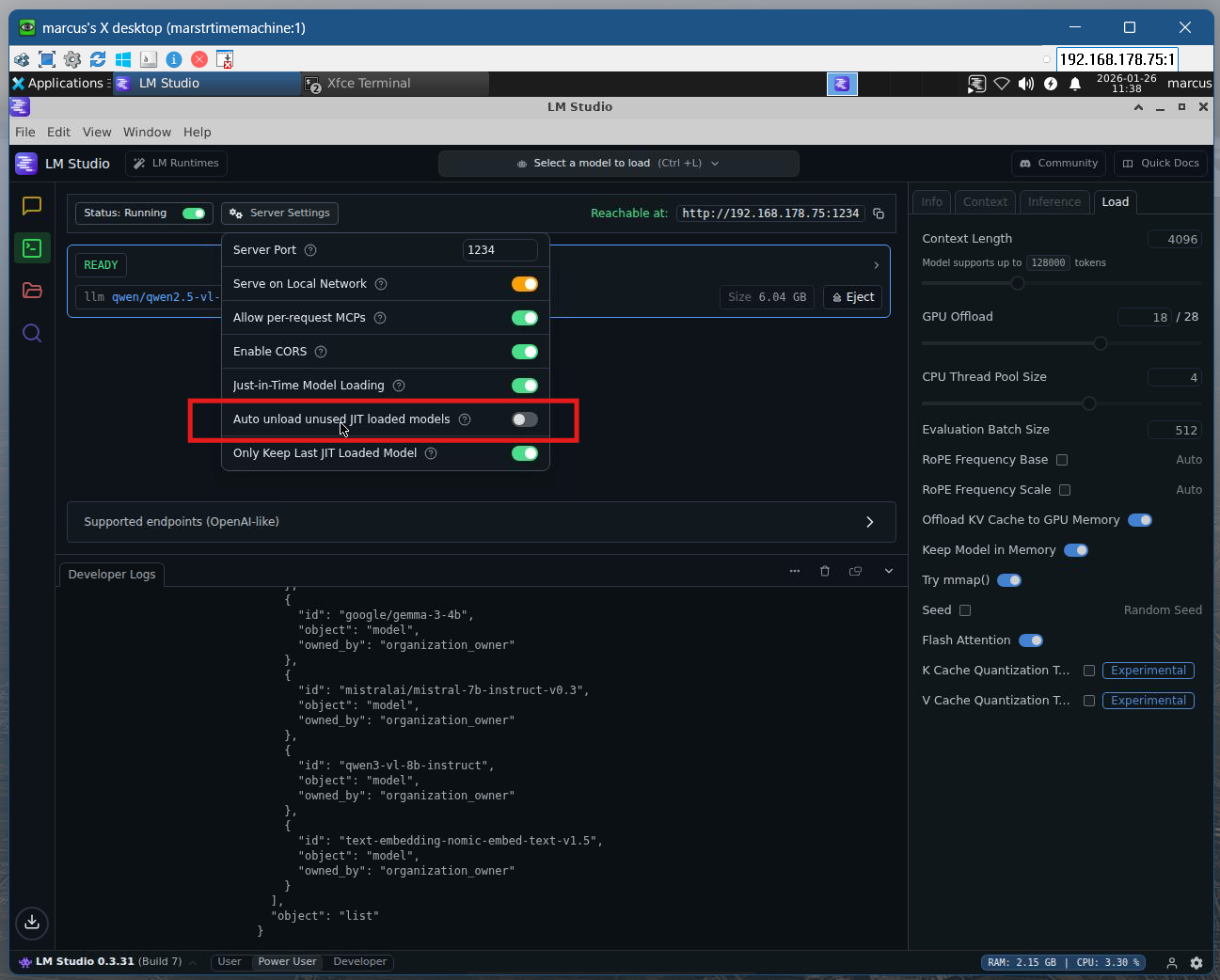

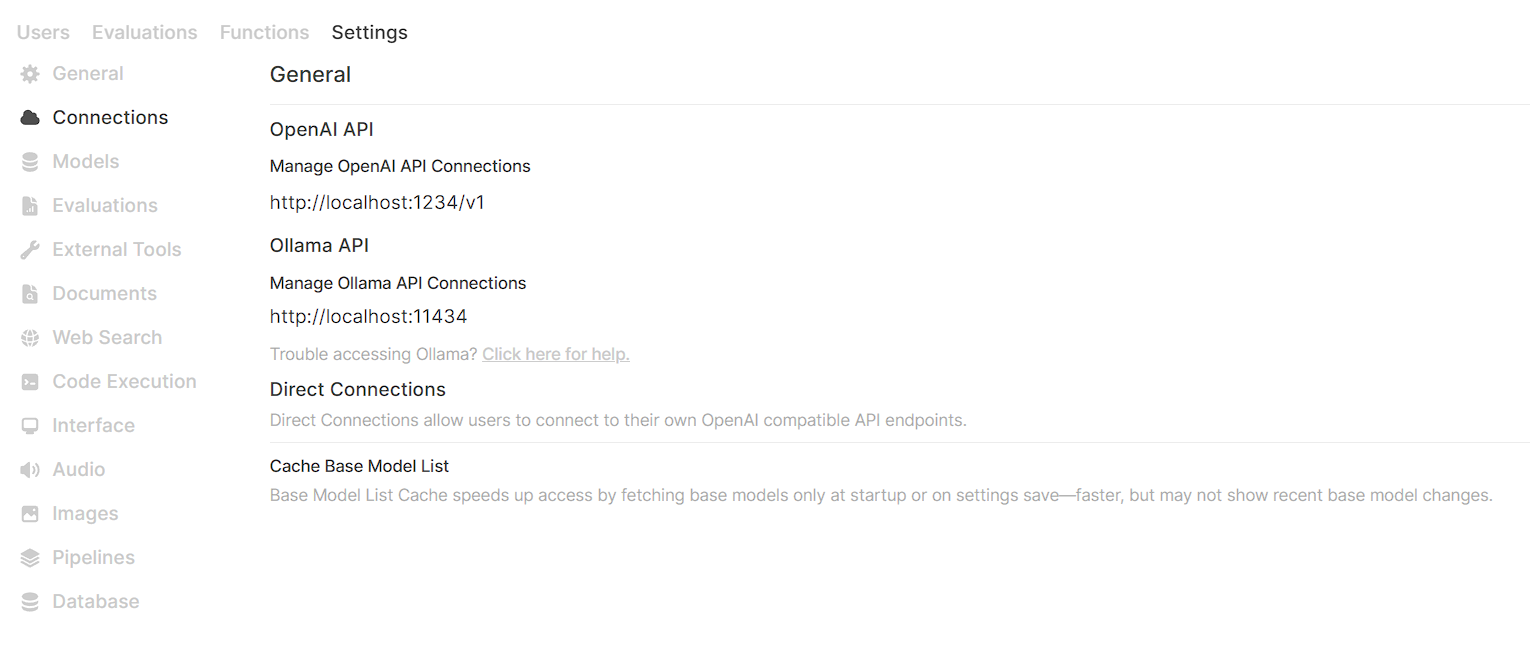

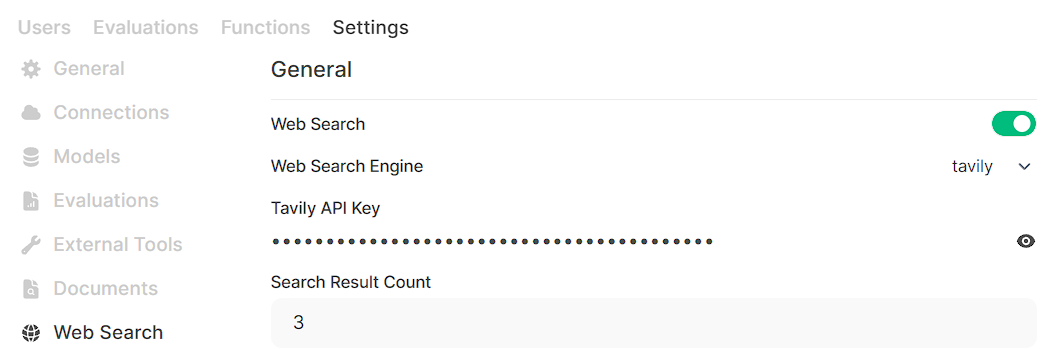

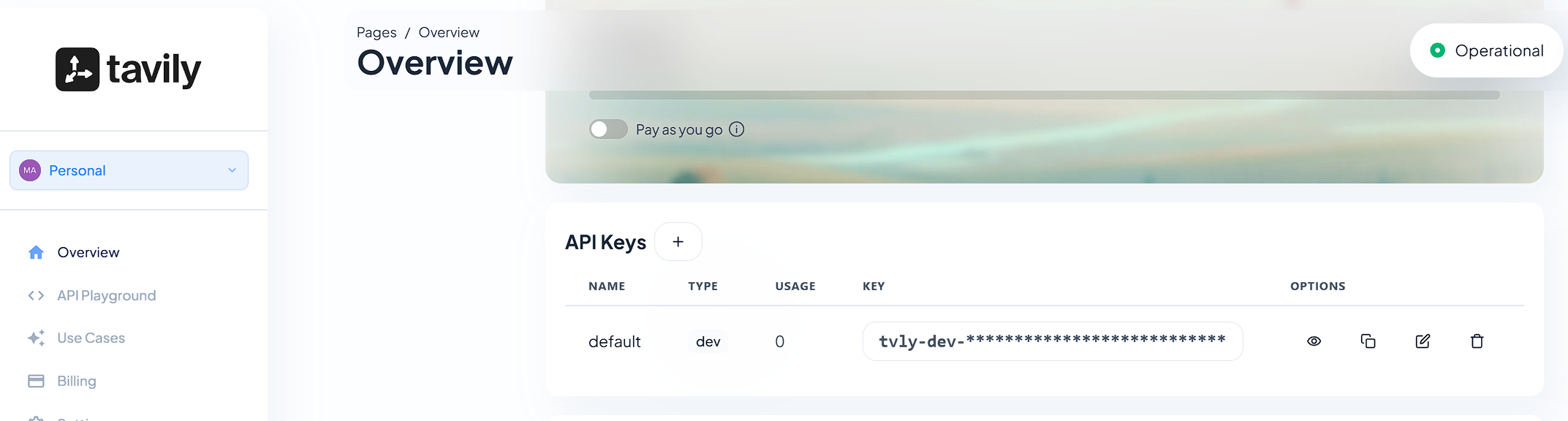

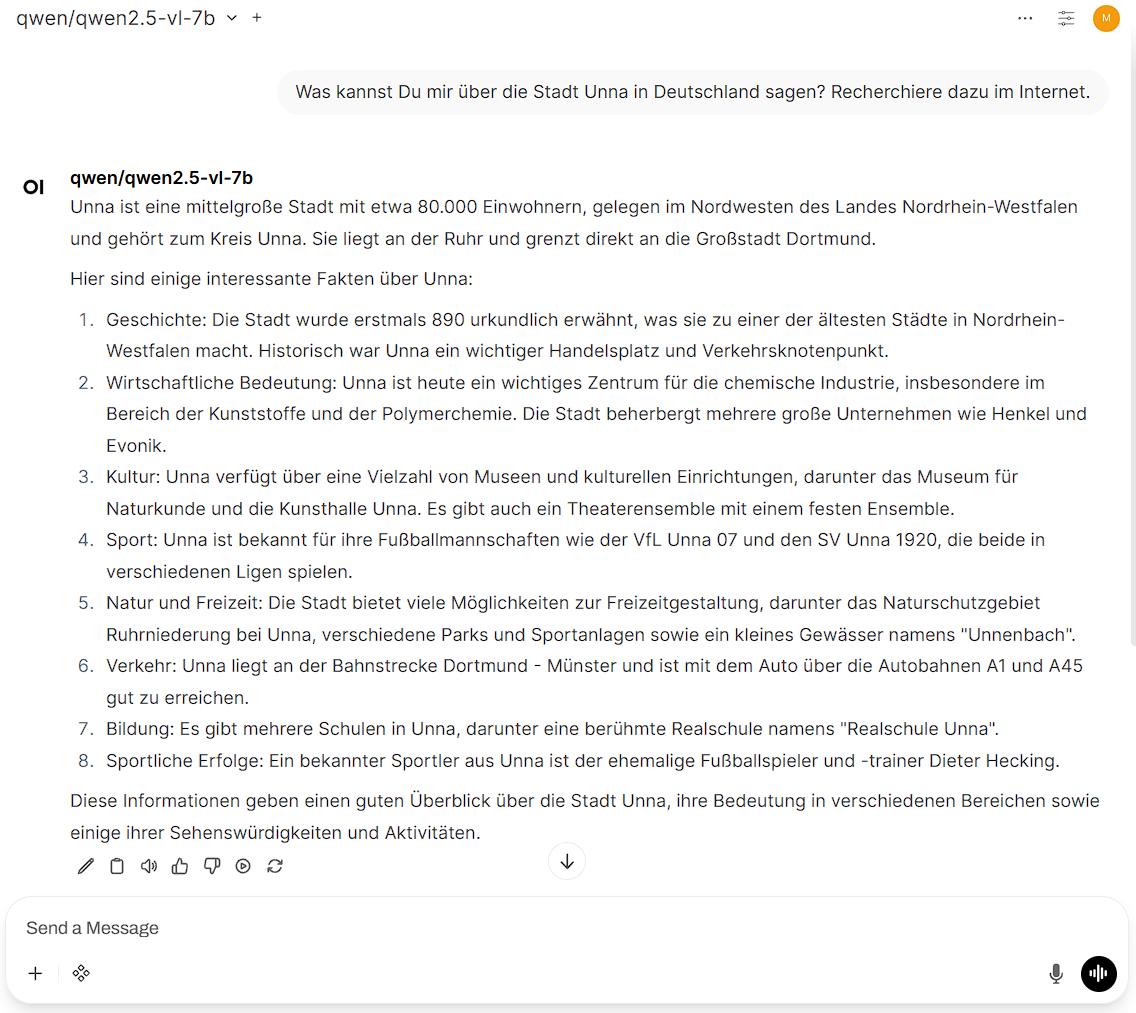

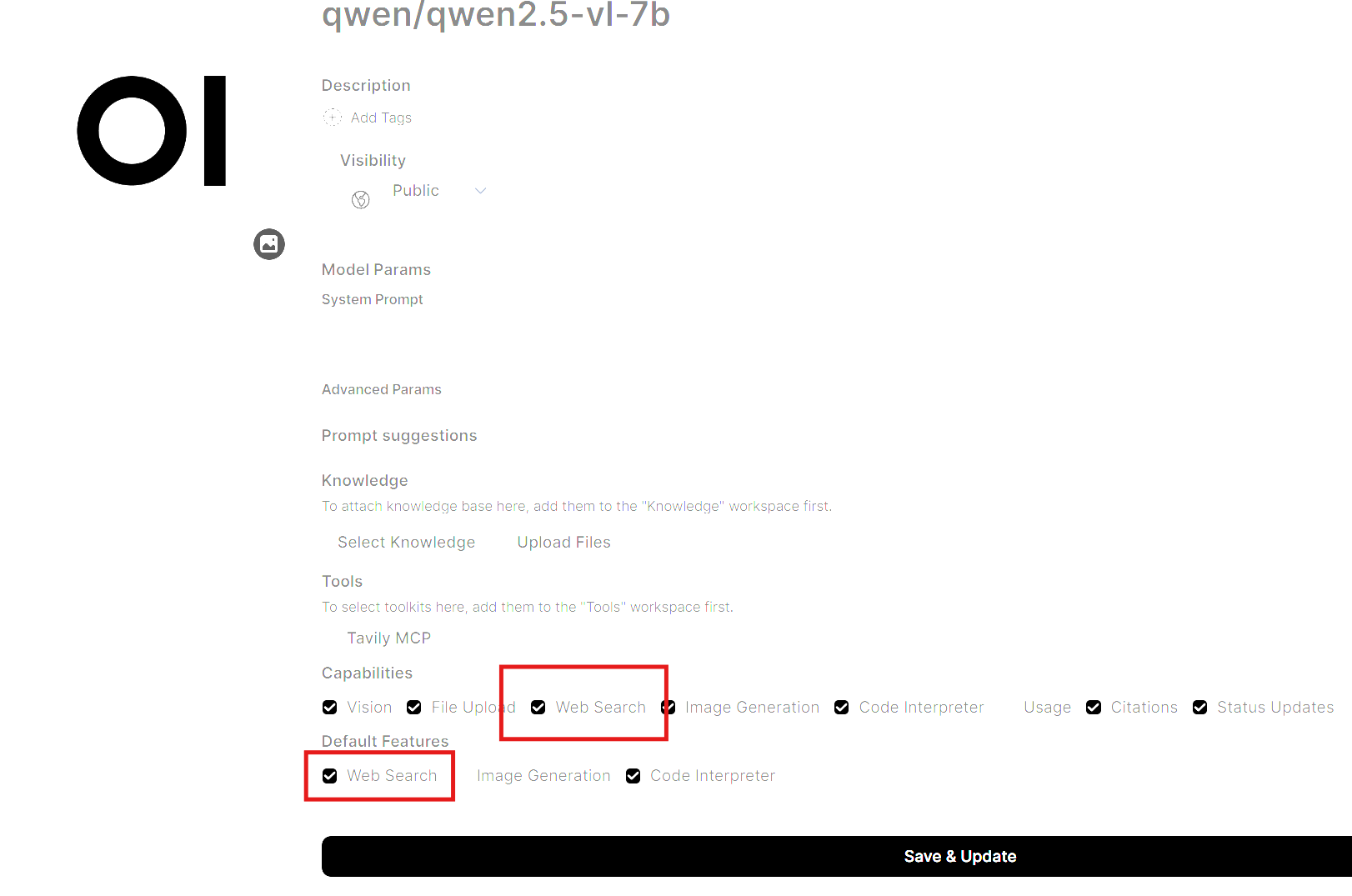

Gepostet: 27.01.2026, 10:45 Da ich nicht all meine KI-Konversationen einem Internet-Service wie ChatGPT anvertrauen will, versuche ich schon seit einer Weile eine lokale Alternative an den Start zu bekommen. Natürlich gibt es da Optionen, die populärste dürfte wohl LM Studio sein. Das läuft auf allem was genug Kapazitäten hat. In meinem Fall habe ich meinen alten PC wieder aus dem Regal geholt, damit die heute ältere RTX2060 mit 6GB VRAM doch noch zu einem guten Einsatzzweck kommt. Sie hat mir viele Jahre wunderbar gedient, vor allem mit VR - was ich nicht gedacht hätte. Warum also nicht mal KI damit versuchen? Ubuntu Server drauf, Xfce4 damit nicht zuviele Resourcen flöten gehen, und dann LM Studio. Da der Rechner nur 16GB RAM hat, und die GPU nur 6GB VRAM, kann man nicht all zu komplexe Modelle laufen lassen... dennoch sollte sich eines für den Alltagsgebrauch finden lassen... oder? In der Tat. Lokale KIs können an sich zwar Fragen beantworten oder auch Analysen anstellen - doch was sie nicht können, ist eine Recherche im Internet anstellen um eine Lösung oder eine Antwort zu finden. Das war bisher der einzige Grund, aus dem ich weiter Online KIs wie ChatGPT oder Gemini benutzt habe. Doch es gibt eine Lösung... schade, dass ich sie erst jetzt gefunden habe. Mein Setup sieht so aus: - LM Studio installiert und geöffnet - Server aktiviert, Port 1234 - und alle Freigaben im Settings-Tab erteilt - OpenWebUI für Python in eigenem Ordner - OpenWebUI in eigenem Prozess im Hintergrund am Laufen, gibt die UI auf Port 90 frei (Account schon erstellt) - Time-To-Live für das Modell auf "unendlich" gestellt, also das automatische Entladen des Modells deaktiviert  So sehen meine LM Studio-Einstellungen aus.  In OpenWebUI muss man die entsprechende Verbindung zur lokalen LLM-API eintragen, damit direkt von der web-basierten Oberfläche, ganz ähnlich zu ChatGPT, Konversationen durchführen kann. Man kann das gewünschte Modell dann auch nach Belieben verändern. Kommen wir nun zum Weg ins Gelobte Land. Wie kriegt meine KI denn nun Internet-Zugang? Es gibt einen Service names Tavily. Zusammengefasst handelt es sich um ein Internet-Gateway, man könnte auch sagen eine Internet-Brücke, für lokale KIs. Der eingesetzte Service, in meinem Fall OpenWebUI, kann diesen einsetzen und an LM Studio durchreichen, um alle möglichen Dinge aus dem Internet zu erfragen. Es funktioniert mit einer REST API. Ein kostenloses Modell ist vorhanden. Wenn man es einmal hochrechnet, sollte die kostenlose Stufe für den Alltagsgebrauch absolut in Ordnung sein. Sollte man dennoch das Limit überschreiten, gibt es eine "Pay as you go"-Option - also nur für das zahlen, was man über dem Limit verbraucht hat. Dieses muss entsprechend in OpenWebUI (oder der Lösung die man On-Premise hat) eingetragen werden:  Logischerweise braucht man dafür einen API-Schlüssel von Tavily. Diesen habe ich direkt erhalten nach dem ich mein Konto erstellt hatte - ich musste nichts weiter tun ausser den Schlüssel von der Startseite zu kopieren:  Wenn man ihn kopiert hat, ist er an der Stelle wie im 3. Bild zu sehen, einzufügen. Zeit für einen Test! Modell: qwen/qwen2.5-vl-7b Frage: Was kannst Du mir über die Stadt Unna in Deutschland sagen? Recherchiere dazu im Internet. Die Antwort war sehr beeindruckend.  Ich denke, dass ich damit keine Online-KIs mehr brauche. Endlich. UPDATE 27/01/26 Man muss diese Funktion noch entsprechend einschalten, denn ansonsten hat das Modell weiterhin keinen Zugang. Dazu ruft man die Einstellungen des Modells in OpenWebUI auf, und setzt die entsprechenden Häkchen:  Nun funktioniert es. Das hatte ich noch vergessen zu erwähnen. KI LMStudio |